Conformité au Règlement Européen sur l'Intelligence Artificielle (AI Act)

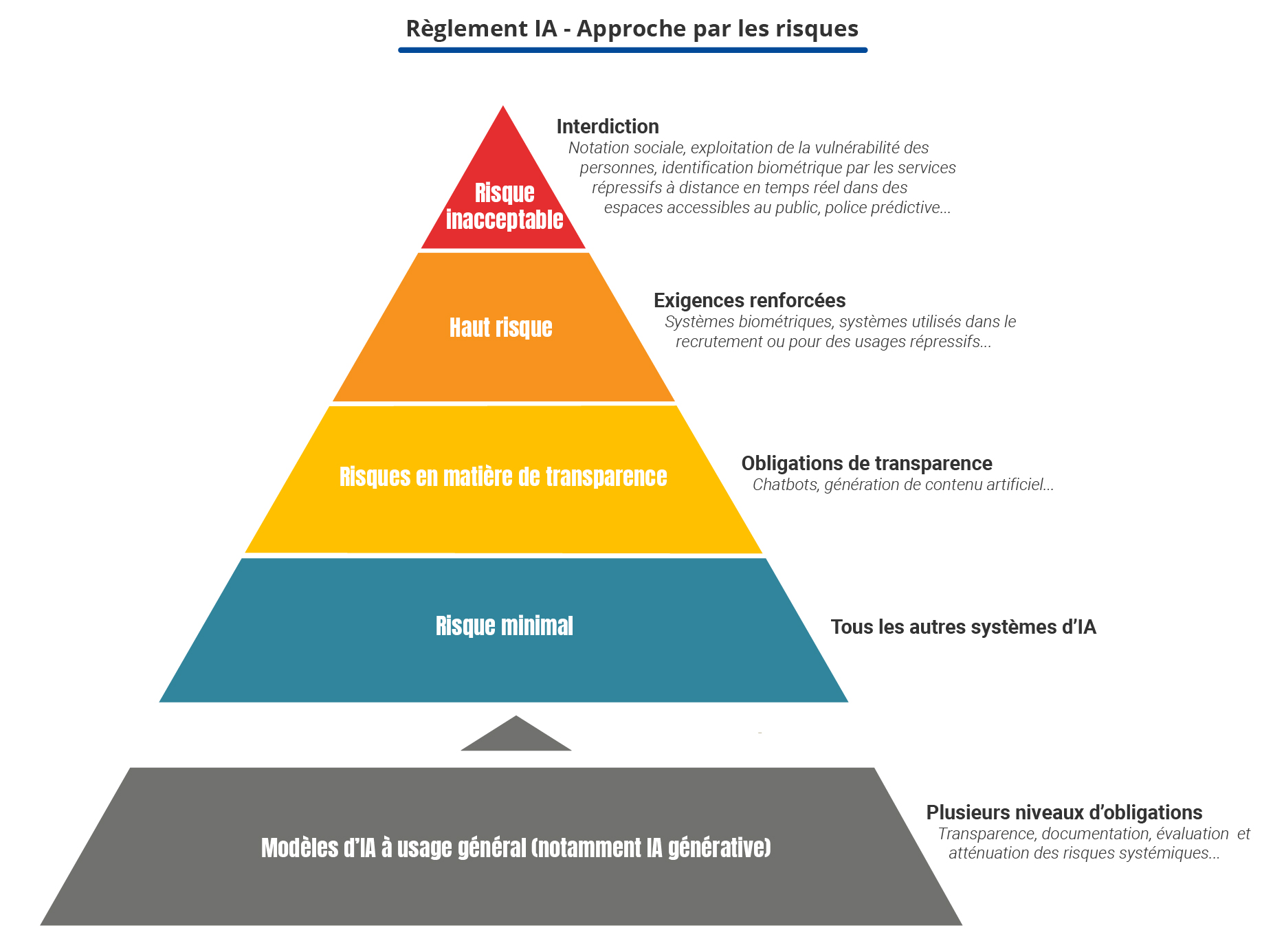

La nouvelle réglementation européenne sur l’intelligence artificielle impose des exigences strictes pour garantir la transparence, la sécurité et l’éthique des systèmes d’IA. Préparez votre entreprise à être en conformité dès maintenant pour éviter des sanctions coûteuses.